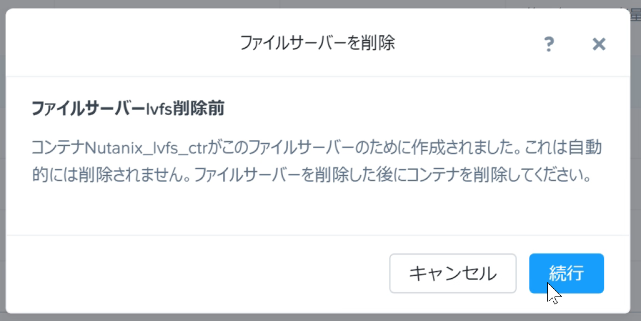

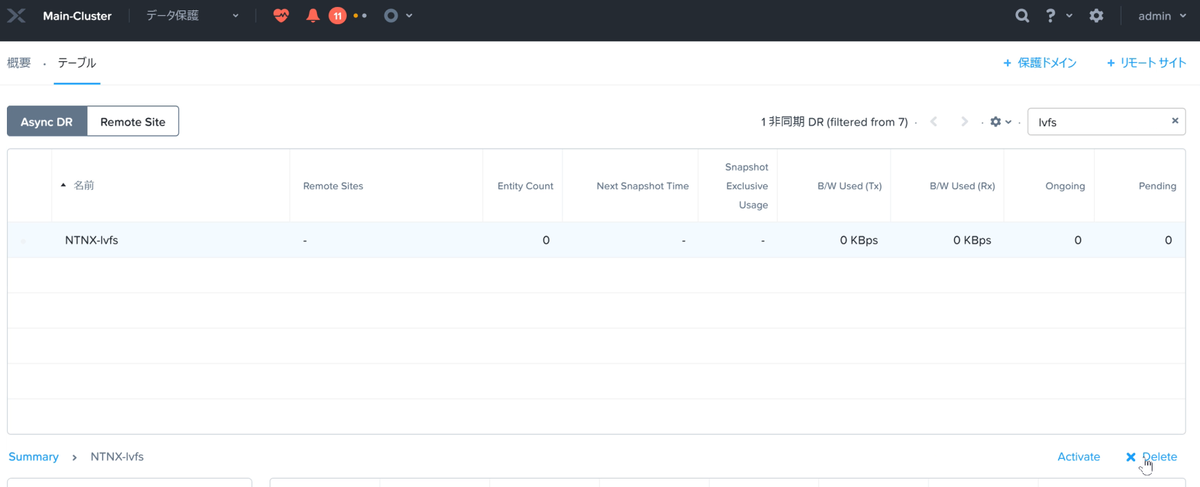

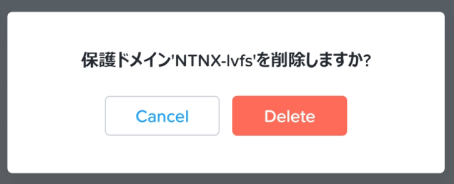

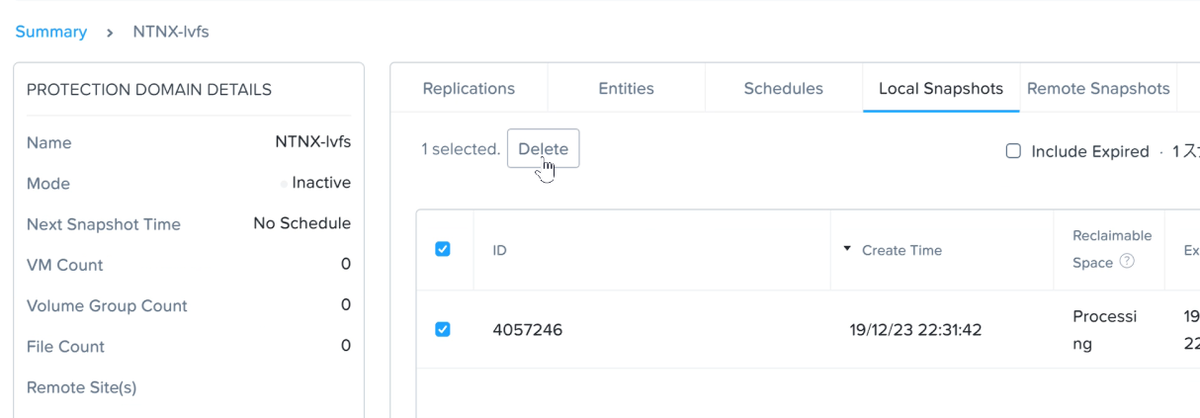

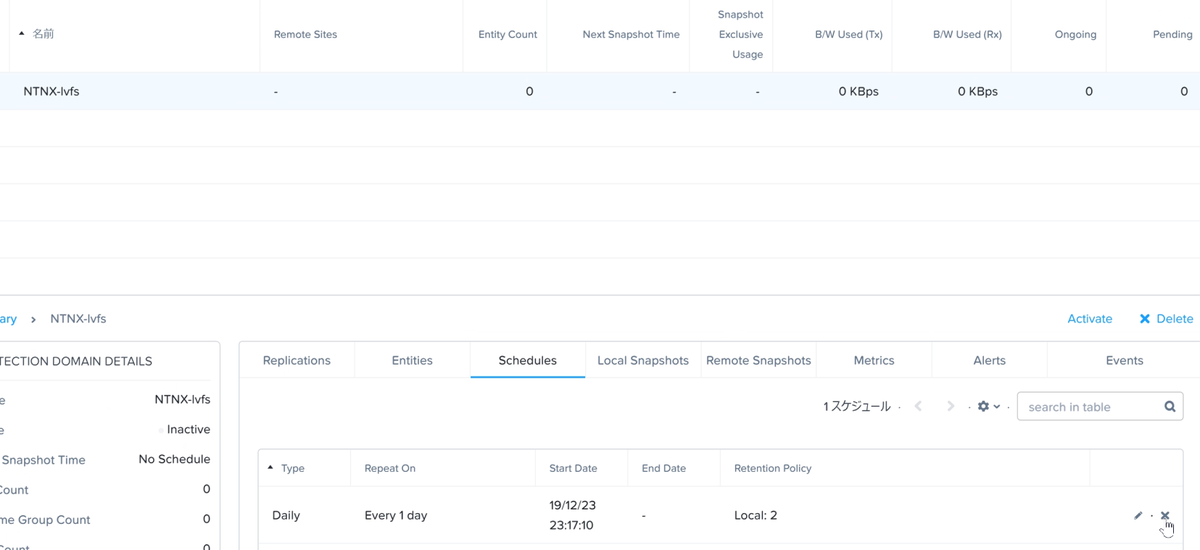

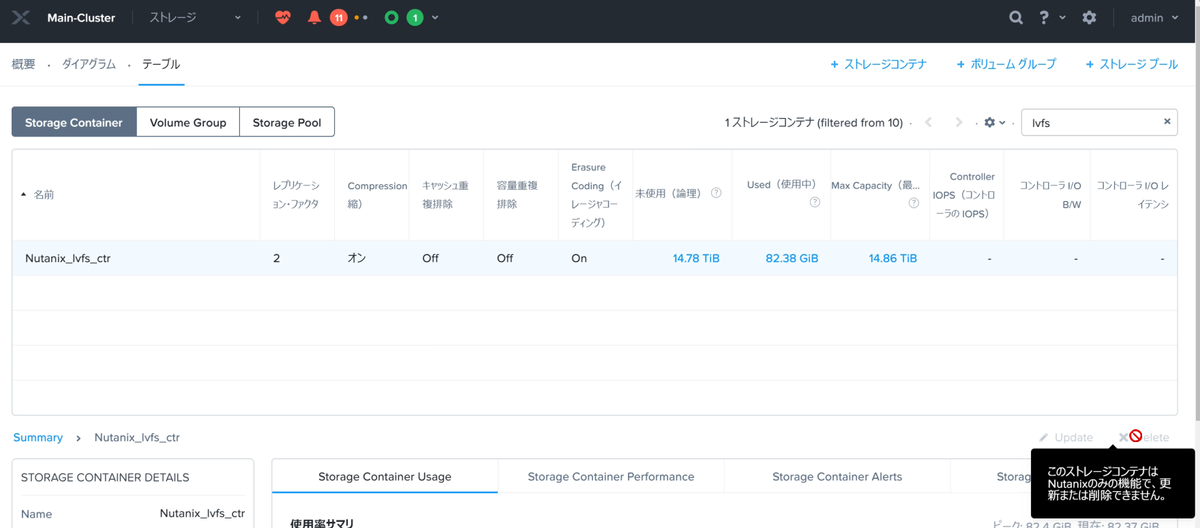

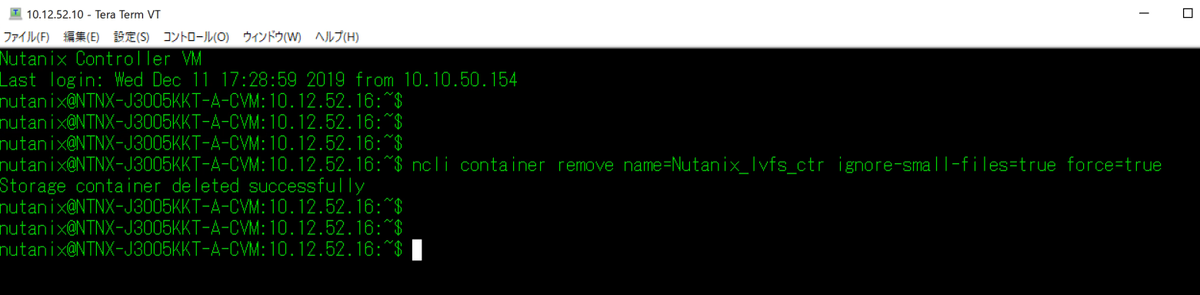

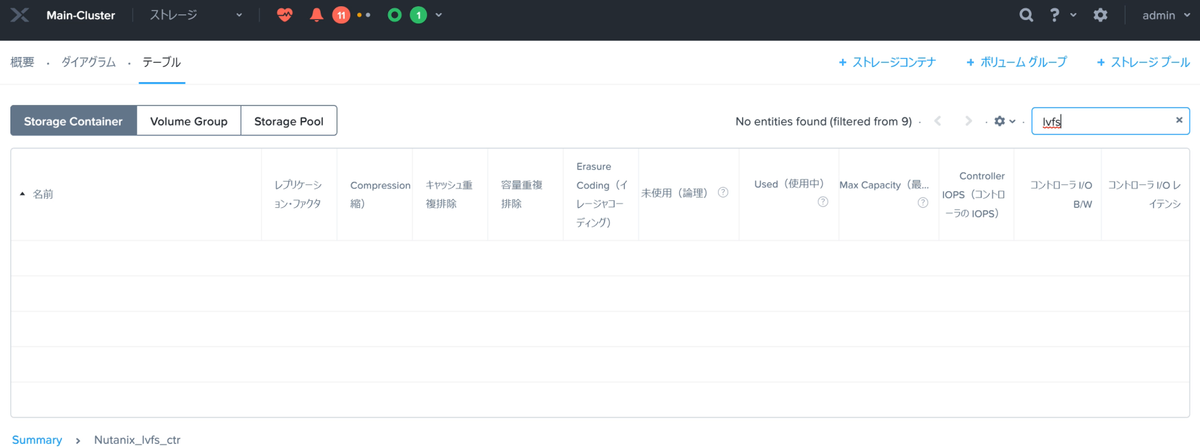

Nutanix Files の間違った消し方

この記事は Nutanix Advent Calendar 3枚目 12月23日 向けに書かれたものです。

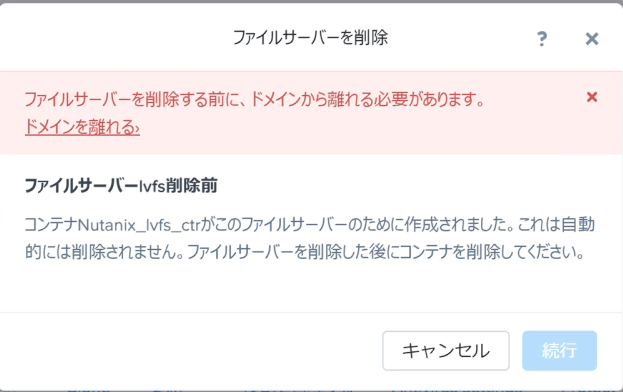

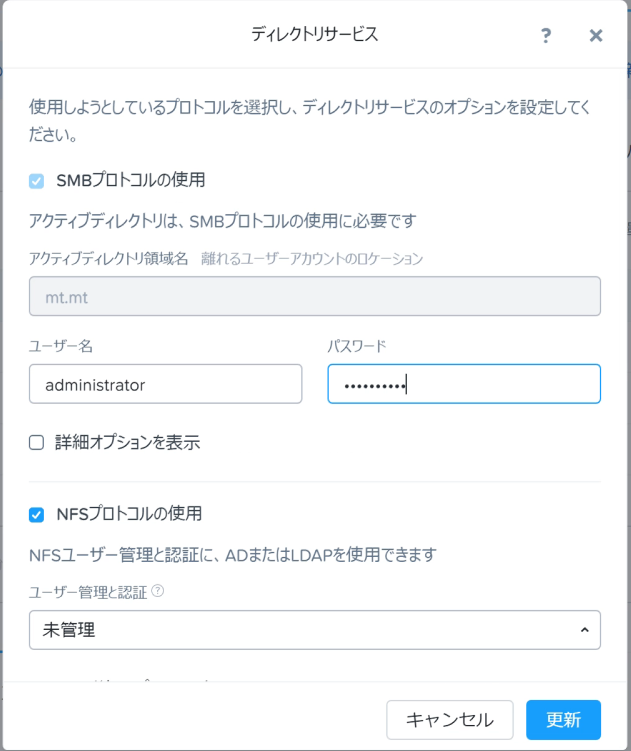

Nutanix Filesの間違った消し方をご紹介します。

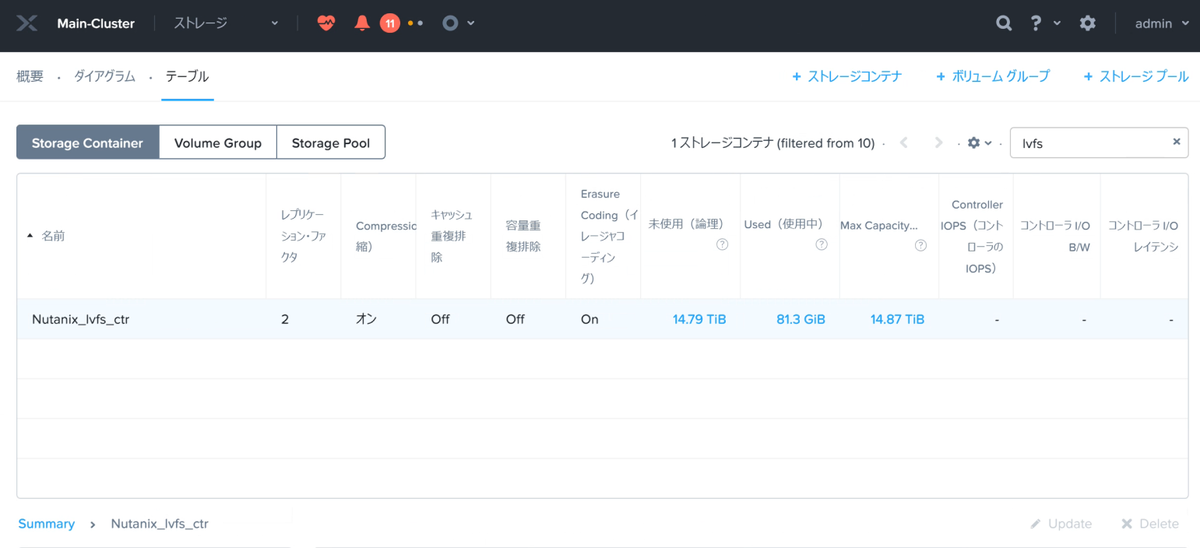

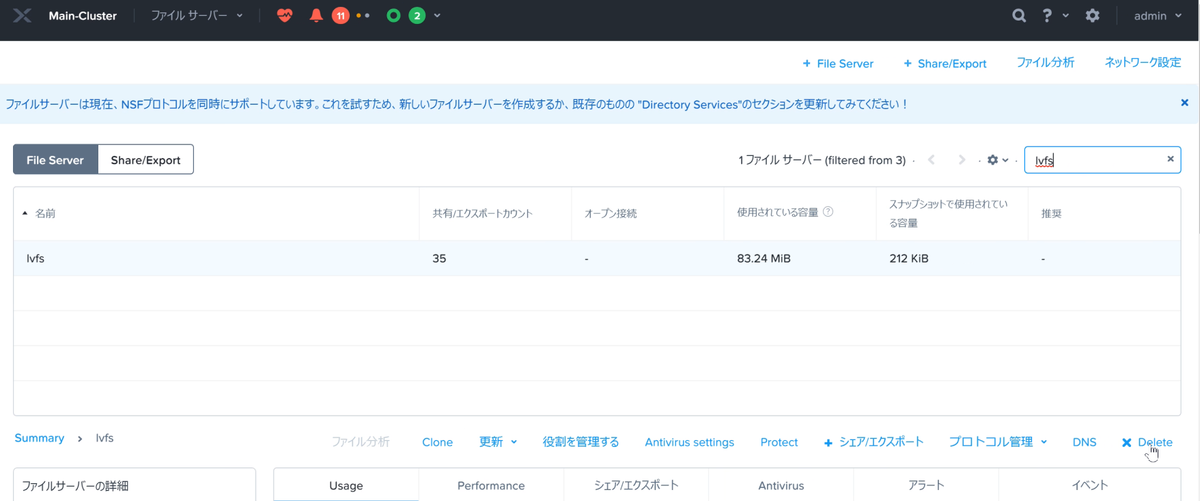

この Nutanix Files "lvfs" は、SMBがメインプロトコルで、NFSがサブプロトコルに設定されています。

というわけで、正しい削除手順は以下の公式ドキュメントをご覧ください。

また force=true などの強制コマンドは想定外の状態になる可能性があるので、Nutanixサポートに確認の上で実施しましょう。

portal.nutanix.com

AOSが入っていないNXアプライアンス

この記事は Nutanix Advent Calendar 3枚目 12月16日 向けに書かれたものです。

NXシリーズを購入した場合、出荷される筐体には AOSがインストールされており、そのまま利用することができます。

ところが、ここ最近の NXシリーズは AOSがインストールされていないようです。

細かい背景についてどこまで書いていいのか分かりませんが、そういう事なっているようです。

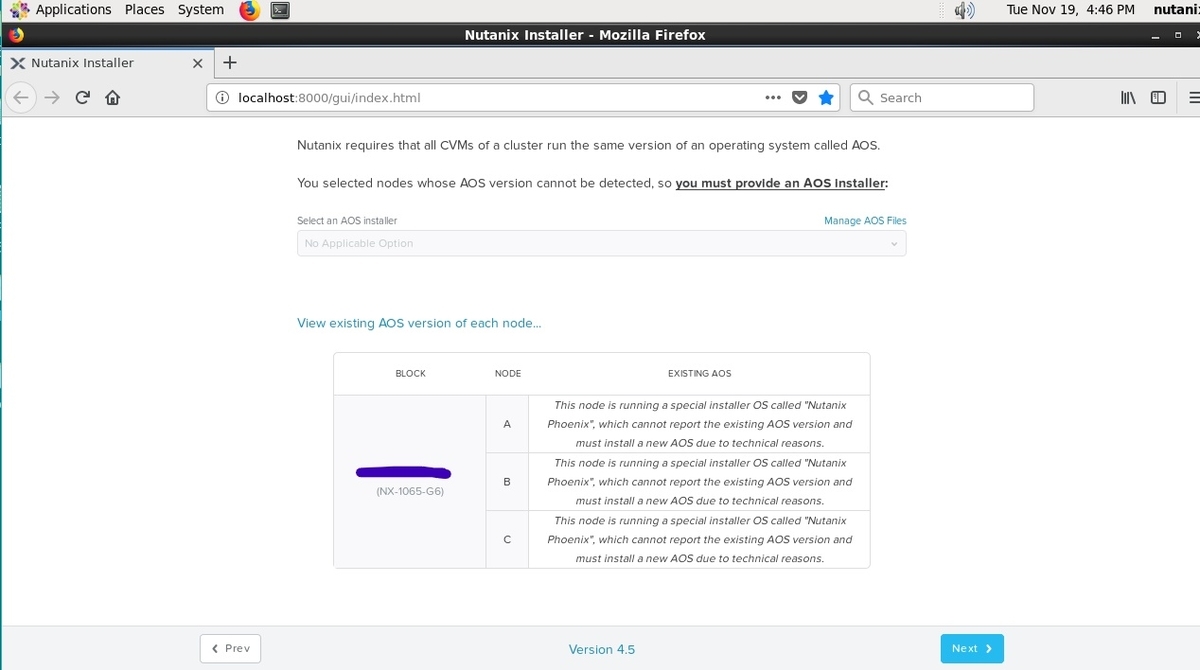

では、実際に出荷された素の NXシリーズを Foundation してみるとどんな表示になるのか?確認してみましょう。

表示されているメッセージがすべてですね。

Phoenix が動作する特殊な状態で、インストール済みのAOSは無く、新たに AOSをインストールする必要があります。

疑問として出てくるのは、既存Nutanixクラスタに追加することはできるのか? という点ですが、AOS 5.11 および Foundation 4.4 以降の Foundation Service が入っていればノード検出できるそうです。

※この情報については公式ドキュメントに記載が無いので、実施する際には裏どりが必要です。早く公式見解がでてくると良いのですが。。。

今後、動作検証する機会があれば別途エントリーを書きます。

以上です。

Horizon Cloud with Microsoft WVD - Tech Preview が始まりました

発表から1年あまり経ちましたが、Microsoft が Windows Virtual Desktop を正式リリースしました。

WVDサポートの Horizon Cloud Service も2020年前半にはリリースされるそうで、現在 VMware は Tech Preview 申し込みを受け付けています。

このブログでも WVD連携を検証したらレポートを上げたいと思います。

それにしても、正式名称だとしたら長すぎですよね「VMware Horizon Cloud Service on Microsoft Azure Extending Microsoft Windows Virtual Desktop」。

Microsoft が2回も入ってる・・・・笑

AHV起動時に CVMが自動起動しない問題

この記事は Nutanix Advent Calendar 3枚目 12月9日 向けに書かれたものです。

Nutanix環境構築をしている際に、AHV停止・起動試験を実施したところ AHV起動時にそのAHV上の CVMが自動起動(Power-on)されない事象に遭遇しました。割合としては Nutanixノードが10台あったとしたら、うち3台くらいで発生しました。

その時に調べた解決方法のご紹介です。

サポートにも問い合わせをしたのですが、Nutanix のクラスタ健全性をチェックするNCC(Nutanix Cluster Check) のログによると以下が原因とのこと。

端的に言うと仮想マシンに対して autostart を有効化することで、AHV起動に合わせて仮想マシンがパワーオンされるようになります。

AHV上から virsh コマンドで autostart を有効化し解決しました。

作業時のログは以下の通りですが、この作業はCVMを手動で起動した後に実施したので、ログ上は running 状態になってます。

[root@ahvhost001 ~]# [root@ahvhost001 ~]# virsh list --autostart Id Name State ----------------------------------------------------

👆まず autostart 状態の仮想マシンがあるかを確認します。何も表示されないですね。

本来はCVM が表示されるはずです。

[root@ahvhost001 ~]# [root@ahvhost001 ~]# virsh list --all Id Name State ---------------------------------------------------- 21 NTNX-ahvhost001-CVM running

👆続いてAHV上にある全ての仮想マシン一覧を出します。

この環境ではCVMしかありませんね。

そして前述のように今回は手動で起動してしまったので running 状態になっています。

[root@ahvhost001 ~]# [root@ahvhost001 ~]# virsh autostart NTNX-ahvhost001-CVM Domain NTNX-ahvhost001-CVM marked as autostarted

👆virsh autostart

CVMが autostart 状態になった旨が表示されます。

[root@ahvhost001 ~]# [root@ahvhost001 ~]# [root@ahvhost001 ~]# virsh autostart --all Id Name State ---------------------------------------------------- 21 NTNX-ahvhost001-CVM running

👆再度、autostart 状態の仮想マシン一覧を表示してみます。

先ほど有効化したCVM名が表示されました。これで完了です。

CVMの autostart 設定がなぜ無効化されたのか原因までは分かりませんでしたが、同じ事象に遭遇したら設定を確認してみましょう。

今回の件は、AHVホスト名を変更したことが影響しているのでは?と思いましたが検証&裏どりはできていません。

また、virsh コマンドは通常のユーザ仮想マシンに使用するものではないので、CVM以外で有効化はやめた方が良さそうです。実施する場合は、サポートにお墨付きをもらってからの方が良いでしょう。

以上です。

【子育て時短】映画の細切れ鑑賞

この記事は オトンとオカンの自分時間捻出術 Advent Calendar 2019 - Adventar 12月2日 向けに書かれたものです。

我が家の家族構成はこんな感じです、大人2人+子供3人なので、大人の方が少なくて日々ドタバタしています。

- 父:ITエンジニア

- 母:会社員

- 子供: ①小学校低学年、②保育園(幼児)、③保育園(乳児)

自分も奥さんも映画、演劇、コンサート、落語などを鑑賞するのが大好きですが、子供ができてからめっきり外出する機会も減りました(交代でお出かけしてますが)。

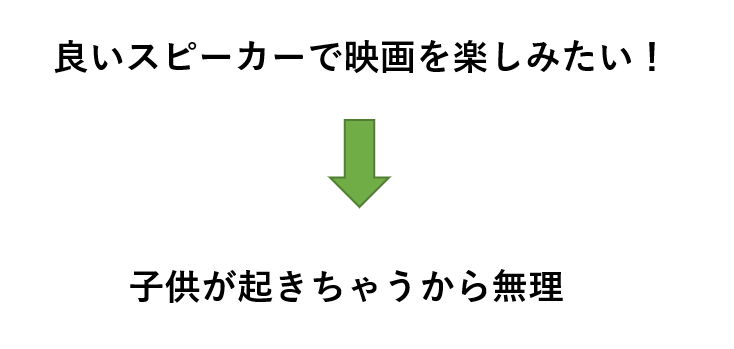

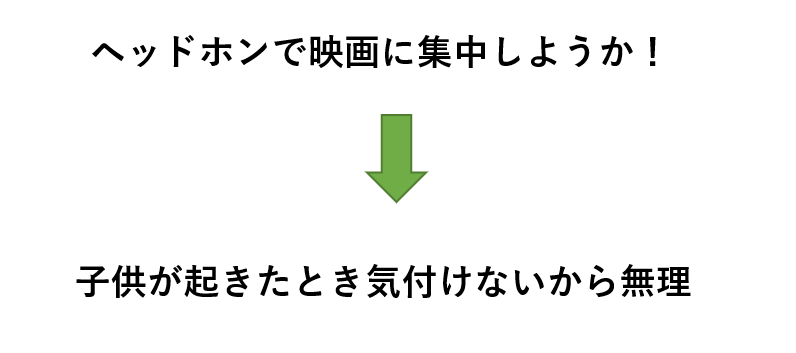

そんな中、家でもできるのが映画鑑賞です。高級なスピーカーを買ったり、良いヘッドホンで映画に没入したりという生活にあこがれますが、小さな子供がいると現実は違いますよね。

テレビで映画を見れる時間なんて子供を寝かしつけたあとの限られた時間しかありません。

しかしこんな些細な幸せさえも一筋縄ではいかぬのが子育てです。

※夜泣きイラストが母親だけっておかしくない!?(余談)

「子供を寝かしつけてから映画を夫婦で見る」は何度チャレンジしましたが、以下のような超えられない壁を幾度となく経験してきました。

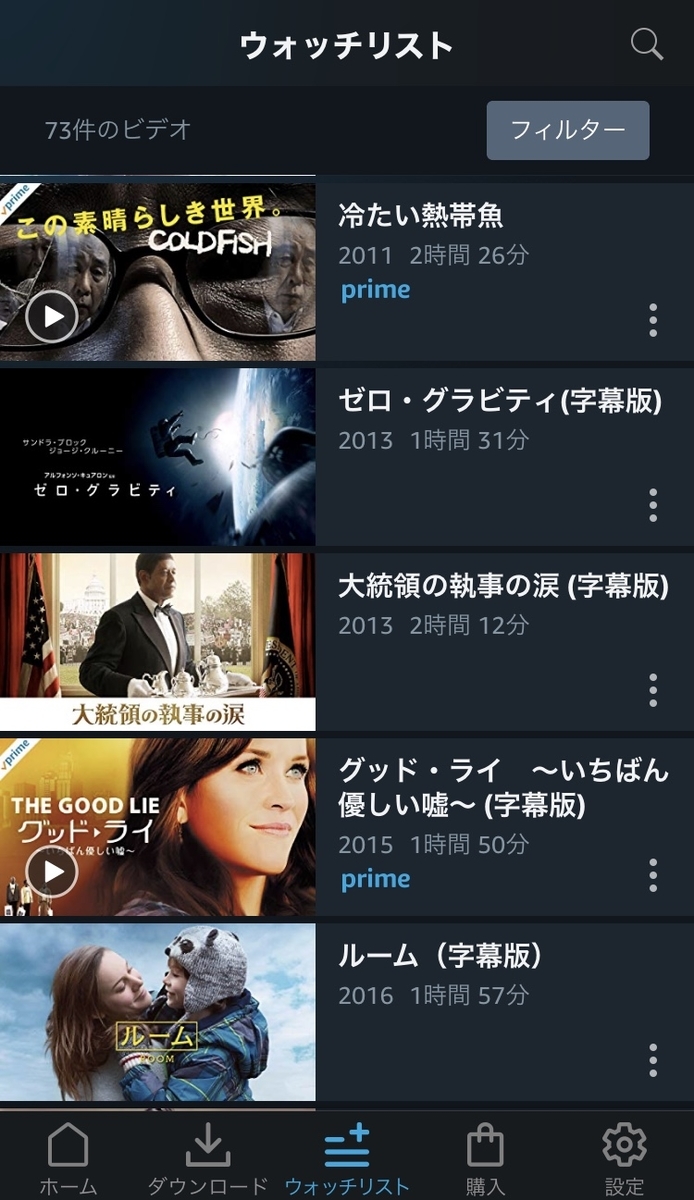

そこで、最近はAmazon Primeビデオなどのオンデマンド動画配信サービスを使って、iPhoneで映画を観ることで日常の細切れな時間を活用しています。

「Prime」という帯が入ったタイトルだけ Primeビデオの対象です。時期で変わるのでいまはPrime対象ではない作品もあります。

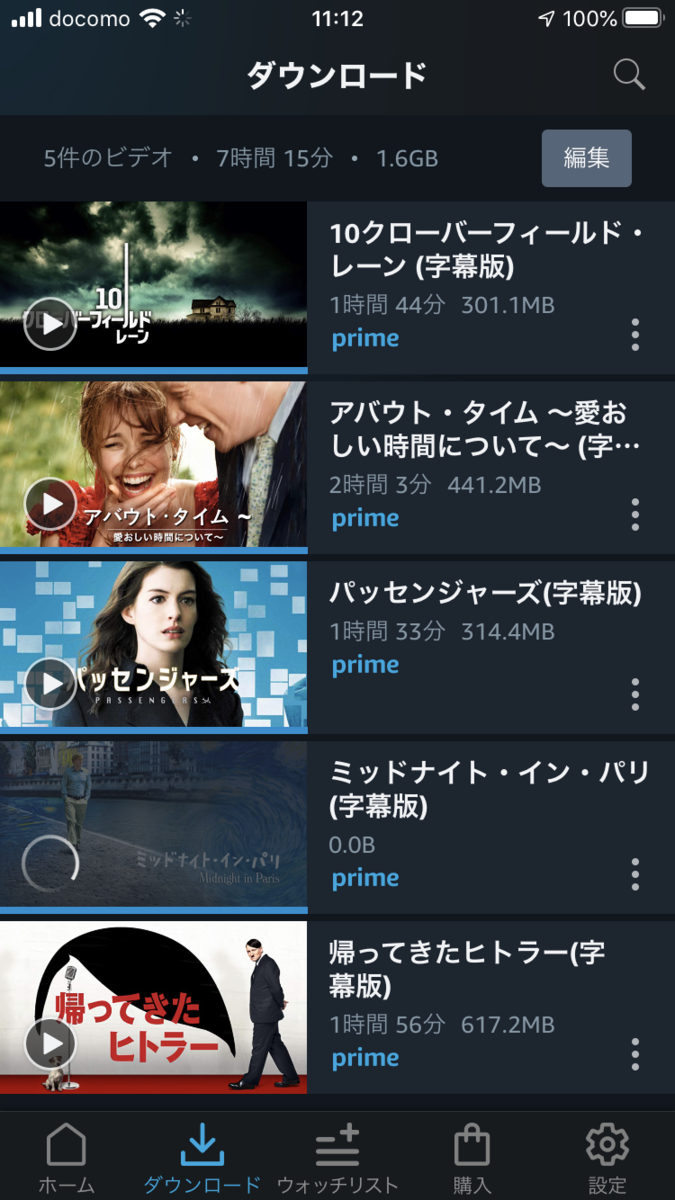

ストリーミングではパケット通信代が勿体ないので、Wi-Fi環境であらかじめダウンロードしておきます。

こうすることで、日常の細切れ時間で映画を観ています。

例えば

- 電車の移動時間(30分 x 往復 = 60分)

- お昼ご飯を食べながら (20分)

- 外出先のちょっとした移動時間/待ち時間(10分)

電車で見れるのは尺の短いアニメとかテレビ番組だけだと考えていました。

最初は、長尺の映画を分割して観るのは違和感だったのですが、意外に気持ちの切り替えもできることに気付きました。2~3日もあれば映画1本みれてしまうので、Yahoo!ニュースを読んだりパズルゲームをしてダラダラ過ごすより満足感が得られるのではと思います。

再生箇所はレジュームできるので、前回止めたところからすぐに再開できます。

夫婦で同じ映画体験を共有できないのは残念ですが。。

最後に、David Lynch 監督が携帯電話で映画を観ることについて語ったインタビューを載せておきますね!

「Fuckin' cell phone!」

Nutanix NXシリーズ G6/G7 の IPMI仕様変更について [BMC 7.00]

この記事は Nutanix Advent Calendar 3枚目 12月2日 向けに書かれたものです。

BMC 7.00 からの仕様変更

Nutanix NXシリーズの G6/G7 モデルで提供されるBMCバージョンをアップデートした際、IPMI管理画面へのログイン仕様が変更になります。

1回でもログイン失敗(パスワード打ち間違い等) すると、ユーザがロックされログインができなくなります。

仕様変更の説明は以下のKBに記載されています。

portal.nutanix.com

この仕様変更、タチが悪いことにユーザがロックされていることが IPMIログイン画面から判断することができません。「正しいパスワードをコピペしてるのに入れない・・・?」って時はユーザロックを疑いましょう。

<補足>

LCMを使用していないと BMCバージョンのアップデート通知に気付かず、7.00へアップデートしてない環境が多いかもしれません。セキュリティの観点からみると、以下のような Security Advisory が適宜公開されており、対策には最新バージョンへのアップデートが必要となります。

http://download.nutanix.com/alerts/Security%20Advisory%2016-v6.pdf

設定確認、変更手順

それでは実際の設定を見ていきましょう。

デフォルト値の確認

BMC 7.00 が適用されたAHV へ SSH接続し、以下のコマンドを実行すると IPMI設定が表示されます。

[root@AHV-001 ~]# ipmitool lan print 1

Set in Progress : Set Complete

Auth Type Support : NONE MD2 MD5 PASSWORD

Auth Type Enable : Callback : MD2 MD5 PASSWORD

: User : MD2 MD5 PASSWORD

: Operator : MD2 MD5 PASSWORD

: Admin : MD2 MD5 PASSWORD

: OEM : MD2 MD5 PASSWORD

IP Address Source : Static Address

IP Address : 192.168.1.31

Subnet Mask : 255.255.255.0

MAC Address : ac:1f:6b:cc:cc:cc

SNMP Community String : public

IP Header : TTL=0x00 Flags=0x00 Precedence=0x00 TOS=0x00

BMC ARP Control : ARP Responses Enabled, Gratuitous ARP Disabled

Default Gateway IP : 192.168.1.254

Default Gateway MAC : 00:00:00:00:00:00

Backup Gateway IP : 0.0.0.0

Backup Gateway MAC : 00:00:00:00:00:00

802.1q VLAN ID : Disabled

802.1q VLAN Priority : 0

RMCP+ Cipher Suites : 1,2,3,6,7,8,11,12

Cipher Suite Priv Max : XaaaXXaaaXXaaXX

: X=Cipher Suite Unused

: c=CALLBACK

: u=USER

: o=OPERATOR

: a=ADMIN

: O=OEM

Bad Password Threshold : 1 👈ログイン試行回数設定、デフォルト1になっている

Invalid password disable: no

Attempt Count Reset Int.: 0

User Lockout Interval : 0

ユーザのロック解除手順

AHVから以下のコマンドを実行して、ユーザ一覧を表示し使用しているユーザの番号を確認しましょう。

デフォルトでは2の「ADMIN」を使用しています。

[root@AHV-001 ~]# ipmitool user list ID Name Callin Link Auth IPMI Msg Channel Priv Limit 1 true false false Unknown (0x00) 2 ADMIN true false false Unknown (0x00) 3 true false false Unknown (0x00) 4 true false false Unknown (0x00) 5 true false false Unknown (0x00) 6 true false false Unknown (0x00) 7 true false false Unknown (0x00) 8 true false false Unknown (0x00) 9 true false false Unknown (0x00) 10 true false false Unknown (0x00) [root@AHV-001 ~]#

続いて以下コマンドを実行して、ユーザを有効化します。

コマンドに対する実行結果は何も表示されませんが大丈夫です。

[root@AHV-001 ~]# ipmitool user enable 2 [root@AHV-001 ~]# [root@AHV-001 ~]#

試行回数制限の無効化手順

この試行回数制限を無効化するには、以下のコマンドを実行します。

[root@AHV-001 ~]# ipmitool lan set 1 bad_pass_thresh 0 0 0 0

実行後、再度IPMI設定を見て Bad Password Threshold が0になっていることを確認します。

[root@AHV-001 ~]# ipmitool lan print 1

Set in Progress : Set Complete

Auth Type Support : NONE MD2 MD5 PASSWORD

Auth Type Enable : Callback : MD2 MD5 PASSWORD

: User : MD2 MD5 PASSWORD

: Operator : MD2 MD5 PASSWORD

: Admin : MD2 MD5 PASSWORD

: OEM : MD2 MD5 PASSWORD

IP Address Source : Static Address

IP Address : 192.168.1.31

Subnet Mask : 255.255.255.0

MAC Address : ac:1f:6b:cc:cc:cc

SNMP Community String : public

IP Header : TTL=0x00 Flags=0x00 Precedence=0x00 TOS=0x00

BMC ARP Control : ARP Responses Enabled, Gratuitous ARP Disabled

Default Gateway IP : 192.168.1.254

Default Gateway MAC : 00:00:00:00:00:00

Backup Gateway IP : 0.0.0.0

Backup Gateway MAC : 00:00:00:00:00:00

802.1q VLAN ID : Disabled

802.1q VLAN Priority : 0

RMCP+ Cipher Suites : 1,2,3,6,7,8,11,12

Cipher Suite Priv Max : XaaaXXaaaXXaaXX

: X=Cipher Suite Unused

: c=CALLBACK

: u=USER

: o=OPERATOR

: a=ADMIN

: O=OEM

Bad Password Threshold : 0 👈 値が0になった

Invalid password disable: no

Attempt Count Reset Int.: 0

User Lockout Interval : 0

全てのAHVホストでコマンド実行するのは面倒なので、CVMへログインして hostssh コマンドを利用するとクラスタの全ホストにコマンド発行ができて便利です。

[nutanix@CVM]# hostssh ipmitool lan set 1 bad_pass_thresh 0 0 0 0

試行回数制限の変更手順

bad_pass_thresh コマンドの後に続く数字を変更することで、ログイン試行の制限回数やその他オプションの変更ができます。

<thresh_num> Bad Password Threshold number.(パスワード入力試行制限回数)

<1|0> 1 = generate a Session Audit sensor event. (セッションauditイベントを作成する)

0 = do not generate an event.(セッションauditイベントを作成しない)

<reset_interval> Attempt Count Reset Interval. In tens of seconds.(試行回数リセットのインターバル、10の倍数秒)

<lockount_interval> User Lockout Interval. In tens of seconds.(ユーザロックのインターバル、10の倍数秒)

それでは。

Horizon Cloud の Pod Manager がついに冗長化対応! [v2.1]

Horizon Cloud Service がアップデートされ、バージョン2.1が公開されました。

いろいろとアップデートがありますが、これまで1台しかデプロイできなかった Pod Managerが冗長化対応しました!

リリースノートからの抜粋です。

Support for high availability of the Horizon Cloud on Microsoft Azure pod managers utilizing the Microsoft Azure Database for PostgreSQL service. Existing pods can be enabled by editing the pod via the Capacity page.

Updated Currently, the pod HA feature is not supported for pods deployed in the following Microsoft Azure cloud environments:

Microsoft Azure in China

Microsoft Azure Germany

Microsoft Azure Government (US Gov Virginia, US Gov Arizona, US Gov Texas)

The VMware team is working on adding support for the HA feature for pods in those above listed cloud environments.

If you have an existing pod in Microsoft Azure in China, Microsoft Azure Germany, or Microsoft Azure Government that you want to upgrade to this release's manifest version, please contact your VMware representative for assistance.

ドキュメントにある構成図も Pod Manager が2つになっています、冗長化構成のため Postgres DB が必要になっています。

Horizon Cloud のキャパシティ展開画面でも変更が反映されています。

Horizon Cloud on Azure のデプロイ事前チェックリストも更新されています。数万/月 程度のサービスが必要になります。

docs.vmware.com

Microsoft Azure Database for PostgreSQL Service — Generation 5, Memory Optimized, 2 vCores, 10 GB Storage

それでは。